Transformer架构

Transformer架构是17年Google团队提出的基于自注意力机制的深度学习架构,核心为编码器-解码器结构,具备并行计算、长序列依赖捕捉优势,是GPT、BERT、ViT等大模型的基础,广泛应用于NLP、计算机视觉、多模态生成等领域。

中文名:

Transformer架构提出时间:

2017年核心机制:

自注意力机制(Self-Attention)核心优势:

并行计算、高效捕捉长序列依赖核心应用领域:

自然语言处理、计算机视觉、多模态生成标志性论文:

《Attention Is All You Need》在Transformer出现之前,序列数据(如文本、语音)的处理长期依赖RNN及其变体(LSTM、GRU),这类模型虽能处理时序信息,但存在并行计算能力缺失、长距离依赖建模失效的致命缺陷;CNN虽能实现局部并行,却无法直接捕捉全局语义关联。Transformer的诞生的解决了这些痛点,通过全局自注意力机制,让模型能够同时关注输入序列中的所有元素,既提升了训练效率,又强化了上下文理解能力,其编码器-解码器的协同设计,使其能够灵活适配翻译、文本生成、问答等多种任务,成为人工智能从“感知”向“认知”跨越的关键技术支撑。如今,Transformer架构已渗透到人工智能的各个领域,不仅是ChatGPT、GPT-4、BERT、LLaMA等主流语言模型的核心骨架,还被广泛应用于计算机视觉(如ViT模型)、语音识别、推荐系统、多模态生成等场景,推动了人工智能技术的快速迭代与产业化落地,成为21世纪以来深度学习领域最具里程碑意义的技术创新之一。

背景历程

诞生背景

2017年之前,深度学习在序列建模领域的发展陷入瓶颈,传统模型的结构缺陷难以满足大规模、高精度的任务需求。当时,自然语言处理(NLP)领域的主流技术路线以RNN及其变体(LSTM、GRU)为主,这类模型采用“逐词处理”的循环结构,即当前输出依赖于前一步的计算结果,这种特性导致其无法利用GPU的并行计算优势,训练效率极低——例如处理一个100词的句子,RNN需依次计算100步,GPU的数千个核心只能闲置等待。同时,RNN类模型存在严重的“梯度消失”问题,当序列长度过长时,早期的语义信息会在循环传递过程中逐渐衰减,导致模型无法捕捉长距离的语义关联。例如在“小明在超市买了一盒牛奶,他回家后把它喝了”这句话中,RNN难以准确识别“它”与“牛奶”的对应关系,因为两者之间存在多个分词间隔。卷积神经网络(CNN)虽能通过卷积核实现局部并行计算,提升训练效率,但它依赖“滑动窗口”提取特征,无法直接建模全局语义关联,且对序列长度敏感,固定尺寸的卷积核难以适配不同长度的文本、语音等序列数据。此外,CNN在处理长序列时,需要通过多层卷积叠加才能捕捉远距离关联,不仅增加了模型复杂度,还容易导致特征失真。针对这些痛点,Google团队的研究者们提出了一种全新的思路:彻底摒弃循环与卷积结构,完全基于注意力机制构建模型,通过“并行计算所有元素的关联关系”,同时解决效率与长距离依赖两大核心问题,Transformer架构由此应运而生。诞生与发展历程

2017年,Ashish Vaswani等人代表Google团队发表了论文《Attention Is All You Need》,正式提出Transformer架构。这篇论文被认为是深度学习领域的分水岭,其提出的自注意力机制、编码器-解码器结构,彻底打破了传统序列建模的框架,为后续大模型的发展奠定了基础。论文中提出的原始Transformer架构包含6个编码器层和6个解码器层,采用多头注意力机制、位置编码等核心设计,在机器翻译任务中取得了远超当时主流模型的效果。2018年,基于Transformer架构的衍生模型开始快速涌现。Google推出BERT模型,采用Transformer的编码器部分,通过“双向注意力”设计,在文本分类、命名实体识别、问答等NLP任务中实现了性能突破,成为当时NLP领域的标杆模型;同年,OpenAI推出GPT模型,基于Transformer的解码器部分,采用“自回归”生成模式,开启了生成式AI的序幕。2019年至2021年,Transformer架构进入快速迭代期,研究者们不断优化其结构与效率:一方面,模型规模持续扩大,从GPT-2的15亿参数,到GPT-3的1750亿参数,模型的语言理解与生成能力实现了质的飞跃;另一方面,架构变体不断出现,如DeBERTa、RoBERTa等模型优化了注意力机制与训练策略,进一步提升了模型性能;同时,Transformer开始向跨领域延伸,ViT模型将其应用于计算机视觉领域,实现了图像分类、目标检测等任务的突破。2022年至今,Transformer架构进入产业化爆发期。ChatGPT的推出让基于Transformer的生成式AI走进大众视野,其背后的GPT系列模型不断迭代,结合强化学习、多模态融合等技术,实现了文本、图像、语音等多维度的交互与生成;同时,业界开始聚焦架构效率的优化,MoE(混合专家)架构、线性注意力等技术的出现,解决了大模型训练与推理成本过高的问题,推动了大模型的规模化应用。结构原理

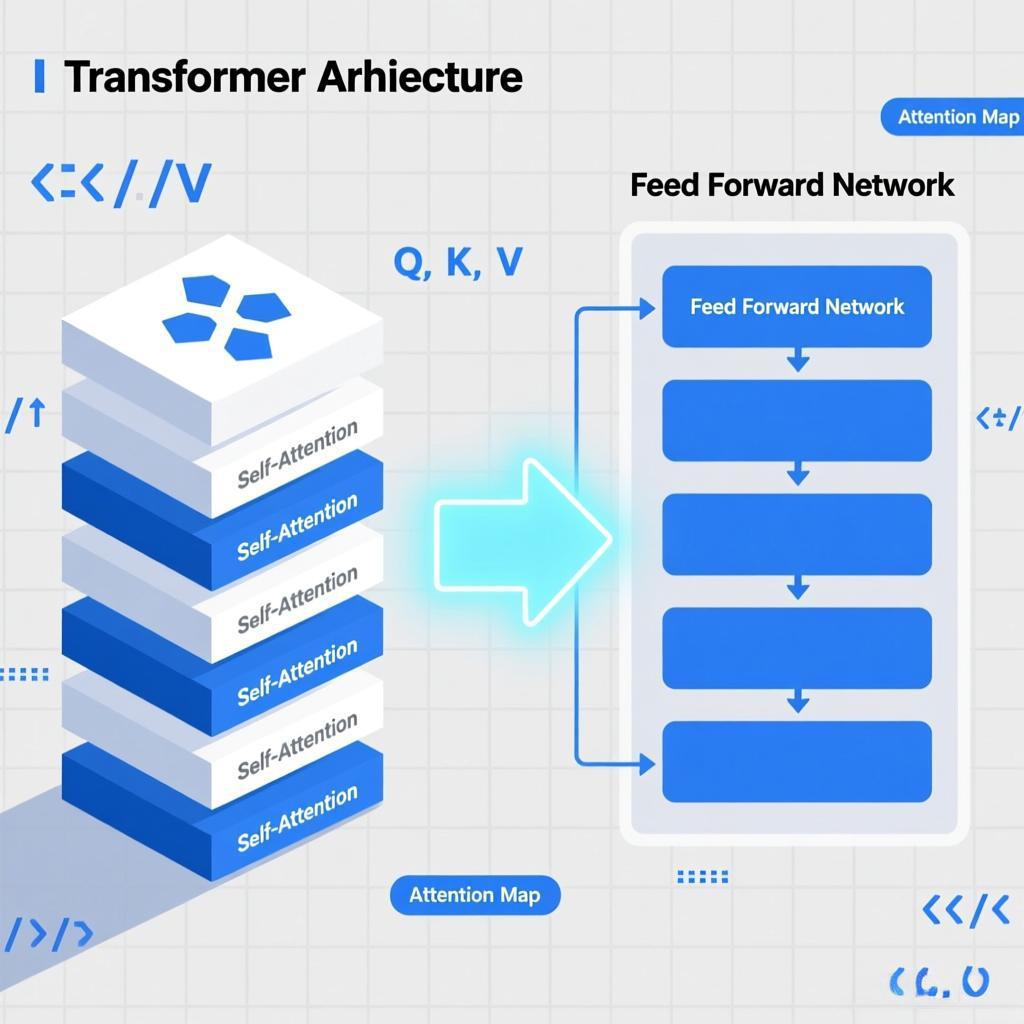

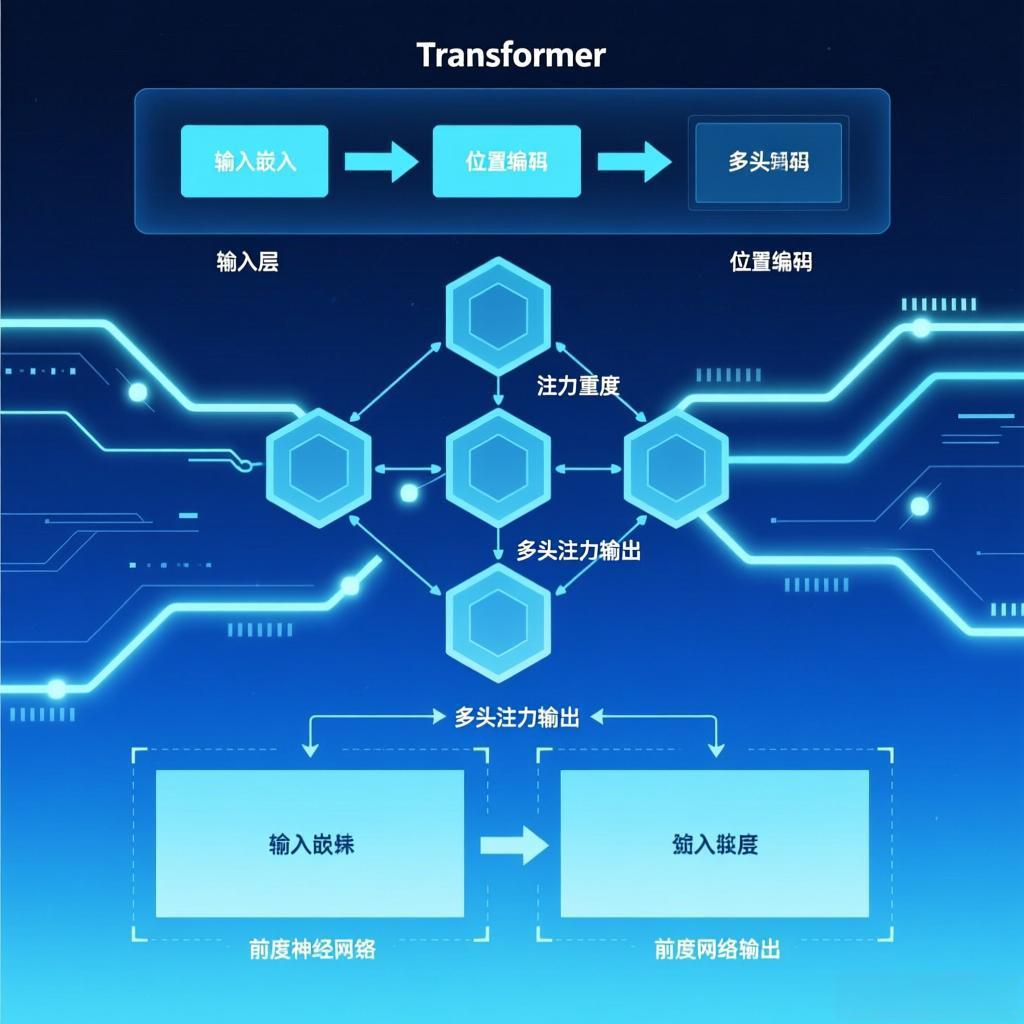

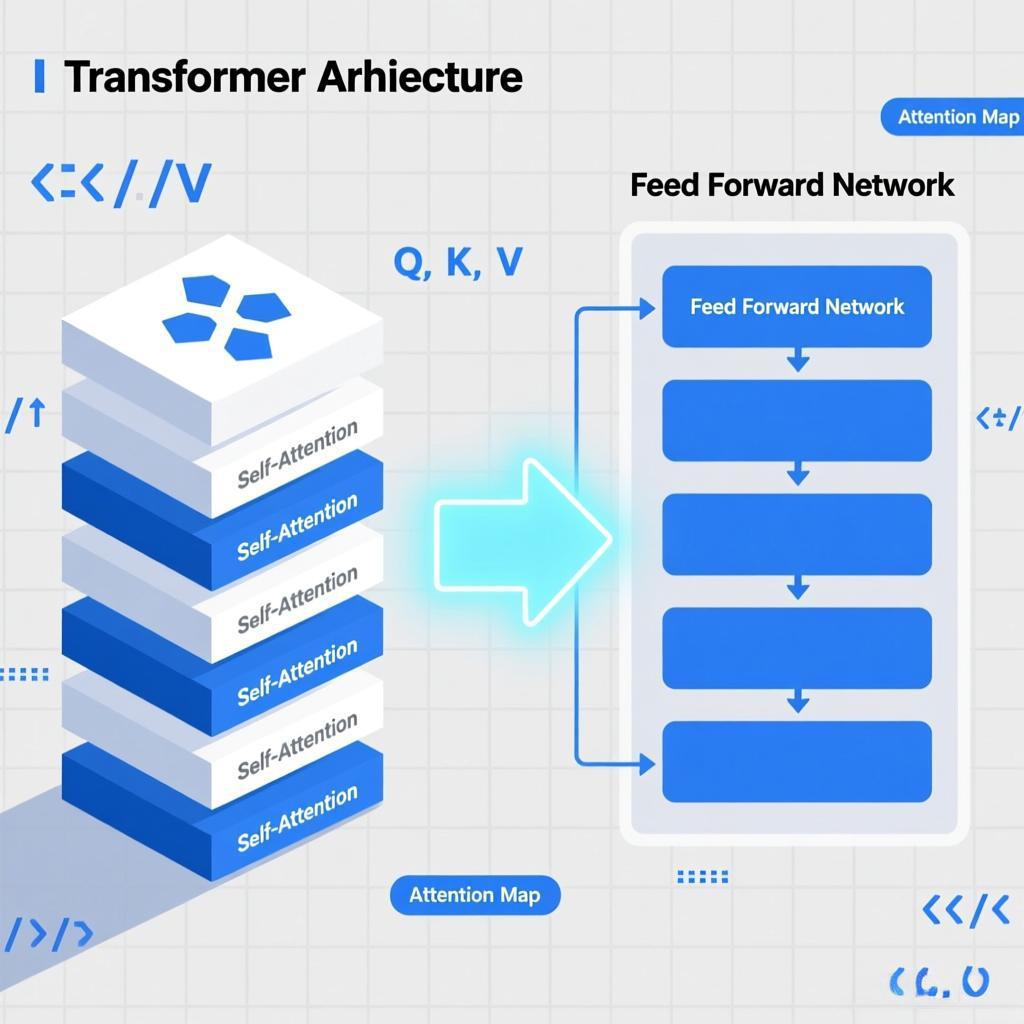

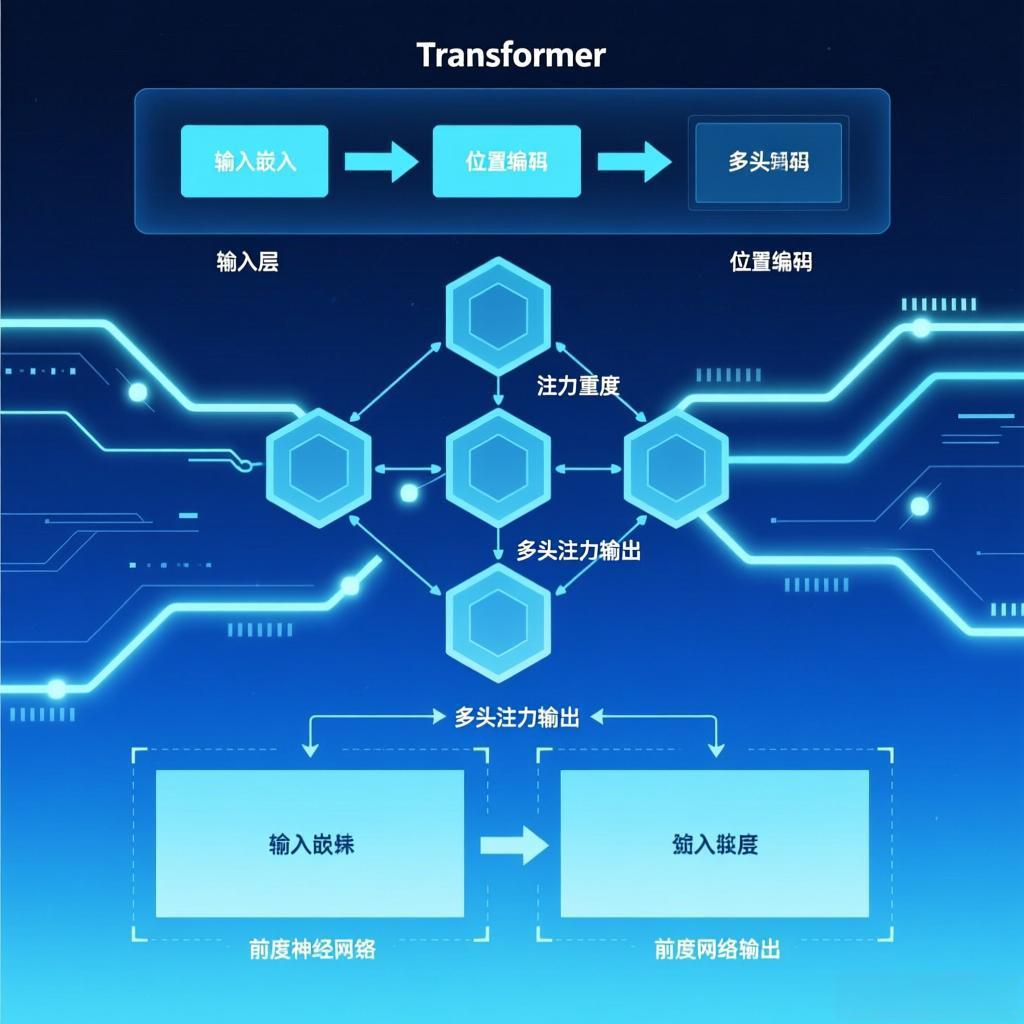

Transformer架构的核心是“编码器-解码器”框架,整体结构对称且模块化,主要由输入处理模块、编码器模块、解码器模块、输出模块四部分组成。其中,编码器负责提取输入序列的上下文语义特征,解码器负责根据编码器的输出生成目标序列,两者通过注意力机制实现协同工作,整个过程无需依赖循环或卷积结构,完全基于并行计算完成。输入处理模块

计算机无法直接理解文本、语音等原始序列数据,因此Transformer的输入处理模块核心任务是将原始序列转化为模型可识别的数值向量,主要包含词嵌入(Word Embedding)和位置编码(Positional Encoding)两个关键步骤。词嵌入是将序列中的每个元素(如单词、子词、语音帧)映射为固定维度的向量,原始Transformer模型中向量维度设定为512维。这种映射并非随机,而是通过模型在训练过程中学习得到——语义相近的元素,其对应的向量距离更近,例如“苹果”与“水果”的向量相似度,远高于“苹果”与“汽车”。词嵌入仅发生在最底层的编码器中,上层编码器接收的是前一层编码器的输出向量。由于Transformer摒弃了循环结构,无法像RNN那样自然捕捉序列的顺序信息(如“我吃苹果”与“苹果吃我”的语义差异),因此需要通过位置编码为每个元素的向量添加位置信息。原始论文采用正弦-余弦函数生成位置向量,偶数维度使用正弦函数,奇数维度使用余弦函数,这种设计的优势在于:位置向量的差值具有周期性,能体现“距离越近的元素关联越强”,且可适配任意长度的序列,无需因输入序列过长而重新训练模型。最终,输入序列经过处理后,形成“词嵌入向量+位置编码向量”的组合向量序列,作为编码器的输入,该向量序列的长度等于输入序列的长度,每个向量的维度为512维。编码器模块

编码器的核心功能是提取输入序列的上下文语义特征,将输入向量转化为“上下文感知的向量表示”——即每个元素的向量不仅包含自身的语义信息,还整合了与序列中其他所有元素的关联关系。原始Transformer的编码器由6个结构相同但参数不同的“编码器层”堆叠而成,每个编码器层包含两个核心子模块:多头自注意力层(Multi-Head Self-Attention)和位置前馈网络(Position-wise Feed Forward Network, FFN),每个子模块后均会添加残差连接(Residual Connection)和层归一化(Layer Normalization)。多头自注意力层是Transformer的“灵魂模块”,其核心逻辑是模拟人类“注意力聚焦”的能力,通过计算序列中每个元素与其他所有元素的关联强度,实现对关键信息的聚焦。具体工作流程分为四步:首先,通过线性变换将输入向量分别映射为三个向量——查询(Query, Q)、键(Key, K)、值(Value, V),三者的维度均为64维;其次,通过Q与K的点积计算“注意力分数”,分数越高,表明两个元素的关联越强;再次,将注意力分数除以√dₖ(dₖ为K的维度,即64),避免分数过大导致Softmax函数梯度饱和;最后,通过Softmax函数将注意力分数转化为0-1之间的权重(所有权重总和为1),再与V向量相乘,得到该元素的注意力输出。“多头”设计(原始模型为8头)是多头自注意力层的关键创新,它将Q、K、V向量拆分为8组并行计算,每组独立完成注意力计算后,再将结果拼接起来,通过线性变换得到最终输出。这种设计相当于让模型从8个不同的“视角”分析元素间的关联,例如有的头关注语法结构,有的头关注语义关联,最终整合得到更全面、更精准的上下文特征。位置前馈网络是一个全连接的前馈神经网络,每个位置的元素向量会单独经过这个相同的网络,实现非线性特征转换。该网络由两个线性层组成,中间通过ReLU激活函数连接,第一个线性层将512维的输入向量映射为2048维,第二个线性层再将其映射回512维。其核心作用是对多头自注意力层提取的关联信息进行“局部细化”,强化元素自身的语义特征与局部上下文的关联,例如在“苹果是一种水果”这句话中,注意力层已捕捉“苹果”与“水果”的关联,前馈网络则进一步强化“苹果属于水果类别”这一特征。残差连接与层归一化是保证模型稳定训练的关键。残差连接将子模块的输入与输出直接相加,有效解决了深层网络训练中的梯度消失问题,让模型能够训练更深的层数;层归一化则对向量进行标准化处理(使向量均值为0、方差为1),避免训练过程中数值波动过大,保证模型训练的稳定性。输入向量经过6层编码器的逐层处理后,最终输出包含全局上下文信息的向量序列,为解码器提供语义参考。

解码器模块

解码器的核心功能是根据编码器输出的语义特征,生成符合任务需求的目标序列(如翻译结果、文本回答、图像描述等)。与编码器类似,解码器由6个结构相同但参数不同的“解码器层”堆叠而成,但每个解码器层包含三个核心子模块:掩码多头自注意力层(Masked Multi-Head Self-Attention)、编码器-解码器注意力层(Encoder-Decoder Attention)和位置前馈网络,同样配备残差连接与层归一化。掩码多头自注意力层与编码器的多头自注意力层结构相似,核心差异在于加入了“掩码机制”。由于解码器生成序列时遵循“自回归”规则——即生成第t个元素时,只能参考前t-1个已生成的元素,无法“偷看”未来未生成的元素,因此需要通过掩码机制遮挡未来位置的注意力分数,将其设为负无穷,经过Softmax函数后权重变为0,确保模型只能基于已生成的元素进行预测。例如生成“我喜欢阅读”这句话时,生成“喜欢”只能参考“我”,生成“阅读”只能参考“我”和“喜欢”。编码器-解码器注意力层是解码器与编码器之间的“桥梁”,其核心作用是让解码器在生成每个元素时,能够聚焦于编码器输出中与之相关的语义信息。该层的工作逻辑与多头自注意力层类似,不同之处在于:Q向量来自解码器前一个子模块的输出,而K、V向量来自编码器的最终输出,通过这种方式,解码器能够精准捕捉输入序列与目标序列之间的关联,例如在机器翻译任务中,生成英文单词时,能够聚焦于中文输入中对应的语义信息。位置前馈网络与编码器中的前馈网络结构完全一致,作用是对编码器-解码器注意力层的输出进行非线性特征转换,细化目标序列的语义特征,确保生成的序列更连贯、更准确。解码器的工作过程是一个迭代生成的过程:初始时,输入为一个“起始标记”,经过解码器层处理后生成第一个目标元素;随后,将生成的第一个元素作为输入,再次经过解码器层处理,生成第二个目标元素;以此类推,直到生成“结束标记”,完成整个序列的生成。输出模块

解码器的最终输出是一个512维的向量序列,输出模块的核心任务是将该向量序列转化为原始序列元素(如单词、像素点)。具体来说,输出模块通过一个线性变换,将512维的向量映射为目标词汇表(或元素集合)的维度,例如在英文翻译任务中,词汇表维度可能为几万维;随后,通过Softmax函数将向量转化为概率分布,每个位置的概率对应一个词汇(或元素),模型选择概率最高的词汇作为当前位置的输出,最终形成完整的目标序列。技术策略

关键技术细节

除了核心结构中的自注意力、位置编码等技术,Transformer架构还包含多项关键技术细节,这些细节共同保障了模型的性能与稳定性。正则化操作是Transformer训练过程中的重要技术,主要包括Dropout和标签平滑(Label Smoothing)。Dropout用于防止模型过拟合,在编码器、解码器的每个子模块输出后,以及词嵌入与位置编码相加后,都会进行Dropout操作,随机丢弃部分神经元的输出,原始论文中设置的丢弃概率为0.1;标签平滑则用于缓解模型对预测结果的过度自信,通过将真实标签的概率分配给相邻标签,减少模型的过拟合风险,原始论文中设置的平滑参数为0.1。线性变换与维度统一是Transformer架构的基础,无论是词嵌入、注意力层中的Q/K/V映射,还是输出模块的词汇表映射,均通过线性变换实现维度的统一与转换,确保各模块之间的输入输出维度匹配,例如将输入向量统一映射为512维,将注意力层的输出映射为512维,保证模型的连贯性。批量归一化与层归一化的结合,进一步提升了模型的训练稳定性。层归一化用于每个子模块的输出,对单个样本的向量进行标准化;批量归一化则用于部分优化场景,对批量样本的向量进行标准化,两者结合有效避免了训练过程中的数值漂移,加速了模型收敛。主流优化策略

随着Transformer架构的广泛应用,研究者们提出了多种优化策略,主要围绕效率提升、性能优化、成本控制三个核心目标,其中最具代表性的包括MoE架构、线性注意力、稀疏注意力等。MoE(混合专家)架构是当前大模型优化的主流方向,其核心思路是将模型参数稀疏化,构建多个“专家子网络”,通过门控网络根据输入内容,仅激活与当前任务相关的1-2个专家子网络,无需激活整个模型的所有参数。这种设计能够有效降低训练与推理的计算成本,实现模型规模与效率的平衡——例如传统稠密模型每次前向传播需激活所有参数,而MoE架构仅激活总参数的10-20%,计算量大幅降低。目前,国产模型如DeepSeek-V3.2、MiniMax-M2、Qwen-2.5等均采用MoE架构,实现了性能与效率的双重提升,但同时也面临专家负载不均、分布式通信成本高的问题,需通过负载均衡算法、硬件协同设计等方式优化。线性注意力是针对自注意力机制O(n²)计算复杂度的优化策略,其核心思路是去掉自注意力中的Softmax函数,通过核函数映射将计算复杂度降至O(n),有效解决了长序列处理时的效率瓶颈。例如阿里Qwen3.5-Plus采用混合注意力机制,将计算复杂度降至O(n log n),推理速度提升19倍;Kimi Linear采用Kimi Delta Attention(KDA),通过精细化门控,在长程任务中的效果可媲美全注意力架构。但线性注意力也存在注意力矩阵低秩、长序列检索准确度下降等问题,因此目前更多采用“全注意力+线性注意力”的混合模式。稀疏注意力则通过“聚焦关键信息”降低计算成本,核心是让模型仅关注输入序列中最重要的Top-k个元素,而非所有元素,将计算复杂度从O(n²)降至O(nk)。例如DeepSeek-V3.2引入的Sparse-Attention,通过闪电索引和动态稀疏策略,仅关注关键元素,在保证模型性能的同时,大幅提升了推理效率;Mistral 7B采用“滑动窗口+全局混合”的稀疏注意力模式,平衡了长文本处理与效率。此外,持续学习、模型记忆等技术也成为Transformer优化的重要方向,Google提出的Titans、MIRAS等算法,通过动态调整模型的学习与记忆方式,解决大模型“灾难性遗忘”问题,让模型能够实现终身学习,进一步提升模型的通用性与实用性。

应用领域

Transformer架构的通用性与高效性,使其广泛应用于人工智能的多个领域,从自然语言处理到计算机视觉,从语音识别到多模态生成,成为推动AI技术产业化的核心动力。自然语言处理(NLP)

自然语言处理是Transformer架构应用最广泛、最成熟的领域,几乎覆盖了所有NLP任务,成为当前NLP技术的核心骨架。在文本生成领域,基于Transformer解码器的GPT系列、LLaMA系列模型,能够实现文本续写、问答、摘要、文案生成等多种任务,ChatGPT、文心一言、通义千问等生成式AI产品,均基于Transformer架构开发;在文本理解领域,基于Transformer编码器的BERT、RoBERTa、DeBERTa等模型,在文本分类、命名实体识别、情感分析、问答匹配等任务中表现优异,广泛应用于搜索引擎、智能客服、内容审核等场景。此外,Transformer架构还推动了机器翻译技术的突破,基于编码器-解码器结构的模型,能够实现多语言之间的精准翻译,解决了传统翻译模型语义丢失、语序混乱的问题,目前主流的机器翻译工具(如Google翻译、百度翻译)均采用Transformer架构优化翻译效果。计算机视觉(CV)

Transformer架构打破了计算机视觉领域长期依赖CNN的局面,通过将图像转化为序列数据(如将图像分割为多个补丁,作为序列元素),实现了图像任务的突破。ViT(Vision Transformer)是Transformer在计算机视觉领域的标志性应用,其将图像分割为固定大小的补丁,通过自注意力机制捕捉补丁之间的关联,在图像分类、目标检测、图像分割等任务中,性能远超传统CNN模型。目前,Transformer已广泛应用于计算机视觉的各个细分场景:在图像生成领域,Stable Diffusion、DALL·E等模型,基于Transformer架构实现了文本到图像、图像到图像的生成,推动了数字艺术、设计等领域的创新;在目标检测领域,DETR模型采用Transformer架构,摆脱了传统目标检测对锚框的依赖,提升了检测精度与效率;在图像分割领域,SegViT等模型通过注意力机制,实现了更精准的像素级分割,应用于医疗影像分析、自动驾驶等场景。多模态融合

多模态融合是当前AI技术的发展趋势,而Transformer架构的注意力机制,为多模态数据(文本、图像、语音、视频)的融合提供了天然优势。基于Transformer的多模态模型,能够实现不同模态数据之间的语义对齐与交互,例如文本到图像生成、图像到文本描述、语音到文本转换、视频摘要生成等任务。例如,GPT-4V、Gemini等多模态模型,基于Transformer架构,能够同时处理文本与图像输入,实现图像识别、图像问答、文本生成等多种跨模态任务;语音识别领域,基于Transformer的模型,能够将语音信号转化为文本,同时捕捉语音中的情感、语气等信息,提升识别精度;视频处理领域,Transformer能够捕捉视频帧之间的时序关联,实现视频分类、视频摘要、动作识别等任务。其他领域

除了上述领域,Transformer架构还被广泛应用于推荐系统、语音合成、自动驾驶、医疗影像分析等场景。在推荐系统中,Transformer能够捕捉用户行为序列与物品之间的关联,提升推荐精度;在语音合成领域,基于Transformer的Tacotron 2等模型,能够生成更自然、更流畅的语音;在自动驾驶领域,Transformer用于处理摄像头、雷达等传感器数据,捕捉车辆、行人等目标的动态关联,提升自动驾驶的安全性;在医疗影像分析领域,Transformer能够精准识别影像中的病变区域,辅助医生进行诊断。

深度解读

Transformer架构的诞生,不仅是深度学习技术的一次技术突破,更是人工智能领域的一次范式变革,其核心价值在于打破了传统序列建模的局限,构建了“注意力优先”的全新建模思路,为人工智能从“局部感知”向“全局认知”跨越提供了可能。从技术本质来看,Transformer的核心创新并非“注意力机制”本身(注意力机制在此之前已被应用于NLP领域),而是“完全基于注意力机制构建整个模型”,摒弃了循环与卷积结构的束缚。这种设计的核心优势的在于实现了“并行计算”与“全局关联”的统一——并行计算提升了模型的训练与推理效率,让大规模模型的训练成为可能;全局自注意力机制则打破了局部特征的限制,让模型能够捕捉长距离的语义、视觉关联,提升了模型的理解与生成能力。

Transformer架构的成功,也离不开其模块化、可扩展的设计理念。编码器与解码器的堆叠结构,使得模型能够通过增加层数、扩大参数规模,持续提升性能;多头注意力、残差连接、层归一化等模块化设计,使得研究者能够根据不同任务的需求,灵活调整模型结构,衍生出多种变体(如仅用编码器的BERT、仅用解码器的GPT、多模态融合的ViT等),适配不同的应用场景。从产业影响来看,Transformer架构推动了人工智能技术的产业化落地,让大模型从“实验室”走向“实际应用”。在此之前,深度学习模型的应用多局限于特定场景,而Transformer架构的通用性,使得模型能够快速适配自然语言处理、计算机视觉、多模态等多个领域,催生了生成式AI、智能客服、自动驾驶、医疗影像分析等一系列新兴产业,深刻改变了人们的生产生活方式。

但同时,Transformer架构也存在一些固有局限:一是计算复杂度较高,传统全注意力机制的O(n²)复杂度,使得长序列处理的效率仍有提升空间;二是模型可解释性较差,注意力权重的分布虽能反映元素间的关联,但难以明确模型的决策逻辑,导致模型在医疗、金融等关键领域的应用受到限制;三是训练成本高昂,大规模Transformer模型的训练需要大量的算力与数据支持,门槛较高,不利于中小企业的参与。未来,Transformer架构的发展将围绕“效率优化、可解释性提升、低成本化”三个核心方向展开:效率优化方面,MoE、线性注意力、稀疏注意力等技术将持续迭代,进一步降低计算成本,提升长序列处理能力;可解释性方面,研究者将通过注意力可视化、因果推理等技术,揭开模型的决策逻辑,提升模型的可靠性;低成本化方面,轻量化Transformer模型、小样本训练技术将不断发展,降低模型的训练与部署门槛,让Transformer架构能够惠及更多领域。

最新消息

2026年以来,Transformer架构持续迭代,在效率优化、多模态融合、工程化落地等方面取得了多项重要突破,成为大模型技术发展的核心驱动力。2026年2月,中金公司发布的《AI十年展望(二十六)》指出,2026年Transformer架构将延续主流地位,MoE架构成为行业共识,平衡性能与效率的优化路线成为焦点。随着英伟达GB系列芯片的成熟与推广,基于更高性能的万卡集群,大模型预训练的Scaling-Law将重现,旗舰模型的参数量将进一步提升,智能上限持续突破。同时,强化学习在Transformer模型训练中的占比将进一步提升,成为解锁模型高级能力的关键,海外OpenAI、Gemini等厂商,国内DeepSeek、阿里千问等企业均在加大强化学习的研发投入。

2026年2月25日,相关技术研究显示,线性注意力与EBT(Energy-Based Transformer)能量模型成为Transformer架构优化的重要方向。阿里Qwen3.5-Plus采用混合注意力机制,将计算复杂度降至O(n log n),推理速度提升19倍,显存占用降低60%;EBT能量模型则彻底颠覆传统前向推理逻辑,通过能量函数迭代优化,仅需传统Transformer三分之二的训练数据,即可达到相同的困惑度,在图像任务中,用1%的推理计算量超越标准Transformer。

在产业应用方面,2026年以来,Transformer架构的轻量化落地成为趋势。字节跳动、阿里、百度等企业纷纷推出轻量化Transformer模型,适配移动端、边缘设备等场景,降低了模型的部署成本;同时,Transformer与行业场景的深度融合加速,在医疗领域,基于Transformer的医疗影像分析模型,能够精准识别早期病变,辅助医生诊断;在教育领域,轻量化Transformer模型用于个性化教学推荐、作业批改等场景,提升教育效率;在工业领域,Transformer用于设备故障检测、生产流程优化等,推动工业智能化升级。

此外,2026年以来,Transformer架构的跨领域融合进一步深化,Google推出的Titans架构,通过“记忆即上下文”机制,将上下文窗口扩展至200万token,大幅提升了长文本处理能力;Meta的Free Transformer为模型注入“潜意识”,让模型在生成前进行内部规划,提升了生成内容的逻辑性与准确性。同时,国产Transformer模型的研发进展显著,DeepSeek-V3.2、MiniMax-M2等模型,在MoE架构、稀疏注意力等方面的优化达到国际领先水平,推动了国产AI技术的自主可控[1][2][3][4]。

词条图片